DeepSeek研究员在线爆料:过年都没歇 还有大招!

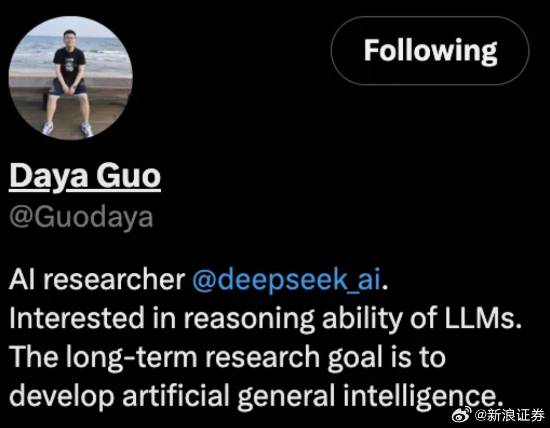

大年初四Daya Guo发了一条推文,透露了春节期间让他最兴奋的事情,亲眼见证了R1-Zero模型性能曲线的 “持续增长”,并且直言感受到了 强化学习(RL)的强大力量。

Daya Guo回复了网友有关DeepSeek R1的一些问题,以及接下来的公司的计划,只能说DeepSeek的R1仅仅只是开始,内部研究还在快速推进,DeepSeek的研究员过年都没歇,一直在爆肝推进研究,接下来DeepSeek还有大招。

网友提问:“如果不是秘密的话:这次RL训练跑了多久?”对此,Daya Guo表示,660B参数的R1-Zero和R1是在V3发布之后才开始跑的,训练大约花了2-3周。

此外,他还表示在尝试将R1应用于形式化证明环境,希望尽快向社区发布更好的模型。听Daya Guo的意思,他们在这方面已经有进展,未来可能会有更重磅的模型发布!期待值拉满!

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

赞助链接

排名

热点

搜索指数

- 1 中共中央召开党外人士座谈会 7904843

- 2 日本附近海域发生7.5级地震 7808942

- 3 日本发布警报:预计将出现最高3米海啸 7712902

- 4 全国首艘氢电拖轮作业亮点多 7616330

- 5 课本上明太祖画像换了 7519648

- 6 中国游客遇日本地震:连滚带爬躲厕所 7425461

- 7 亚洲最大“清道夫”落户中国洋浦港 7329962

- 8 日本地震当地居民拍下自家书柜倒塌 7236964

- 9 银行网点正消失:今年超9000家关停 7143091

- 10 “人造太阳”何以照进现实 7046517

![三岛迪仔[咖啡]OOTD 阴天倔强的羽绒服 天台被路灯照的背景发光](https://imgs.knowsafe.com:8087/img/aideep/2023/4/9/7d95556f999ecf3aaa8ee9da7e89291e.jpg?w=250)

倪哇哇

倪哇哇