ChatGLM :千亿基座的对话模型启动内测,单卡版模型已全面开源

近日,由清华技术成果转化的公司智谱 AI 开源了 GLM 系列模型的新成员——中英双语对话模型 ChatGLM-6B,支持在单张消费级显卡上进行推理使用。这是继此前开源 GLM-130B 千亿基座模型之后,智谱 AI 再次推出大模型方向的研究成果。与此同时,基于千亿基座模型的 ChatGLM 也同期推出,初具问答和对话功能,现已开启邀请制内测(内测申请网址 chatglm.cn ),后续还会逐步扩大内测范围。

开源的地址:https://github.com/THUDM/ChatGLM-6B

什么是 ChatGLM-6B?

据悉,ChatGLM-6B 是一个开源的、支持中英双语问答的对话语言模型,并针对中文进行了优化。该模型基于 General Language Model (GLM) 架构,具有 62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。

ChatGLM-6B 使用了和 ChatGLM 相同的技术,针对中文问答和对话进行了优化。经过约 1T 标识符的中英双语训练,辅以监督微调、反馈自助、人类反馈强化学习等技术的加持,62 亿参数的 ChatGLM-6B 虽然规模不及千亿模型,但大大降低了推理成本,提升了效率,并且已经能生成相当符合人类偏好的回答。

ChatGLM-6B 有什么优势?

具体来说,ChatGLM-6B 具备以下特点:

充分的中英双语预训练:ChatGLM-6B 在 1:1 比例的中英语料上训练了 1T 的 token 量,兼具双语能力。

优化的模型架构和大小:吸取 GLM-130B 训练经验,修正了二维 RoPE 位置编码实现,使用传统 FFN 结构。6B(62亿)的参数大小,也使得研究者和个人开发者自己微调和部署 ChatGLM-6B 成为可能。

较低的部署门槛:FP16 半精度下,ChatGLM-6B 需要至少 13 GB 的显存进行推理,结合模型量化技术,这一需求可以进一步降低到 10GB(INT8) 和 6GB(INT4),使得 ChatGLM-6B 可以部署在消费级显卡上。

更长的序列长度:相比 GLM-10B(序列长度1024),ChatGLM-6B 序列长度达 2048,支持更长对话和应用。

人类意图对齐训练:使用了监督微调 (Supervised Fine-Tuning)、反馈自助(Feedback Bootstrap)、人类反馈强化学习(Reinforcement Learning from Human Feedback)等方式,使模型初具理解人类指令意图的能力。输出格式为 markdown,方便展示。

基于以上特点,ChatGLM-6B 在一定条件下具备较好的对话与问答能力,以下是 ChatGLM-6B 的对话效果展示:

ChatGLM-6B 的不足

由于 ChatGLM-6B 模型的容量较小,不可避免的存在一些局限和不足,包括:

相对较弱的模型记忆和语言能力。在面对许多事实性知识任务时,ChatGLM-6B 可能会生成不正确的信息,也不太擅长逻辑类问题(如数学、编程)的解答。

可能会产生有害说明或有偏见的内容:ChatGLM-6B 只是一个初步与人类意图对齐的语言模型,可能会生成有害、有偏见的内容。

较弱的多轮对话能力:ChatGLM-6B 的上下文理解能力还不够充分,在面对长答案生成和多轮对话的场景时,可能会出现上下文丢失和理解错误的情况。

ChatGLM 线上模型内测

同时,智谱 AI 还开启了 ChatGLM 线上模型的内测。相比起 ChatGLM-6B,ChatGLM 线上模型的能力提升主要来源于独特的千亿基座模型 GLM-130B。它采用了不同于 BERT、GPT-3 以及 T5 的 GLM 架构,是一个包含多目标函数的自回归预训练模型。2022 年 11 月,斯坦福大学大模型中心对全球 30 个主流大模型进行了全方位的评测,GLM-130B 是亚洲唯一入选的大模型。在与 OpenAI、Google Brain、微软、英伟达、Meta AI 的各大模型对比中,评测报告显示 GLM-130B 在准确性和公平性指标上与 GPT-3 175B (davinci) 接近或持平,鲁棒性、校准误差和无偏性优于 GPT-3 175B (下图)。

基于千亿基座的 ChatGLM 线上模型目前在 chatglm.cn 进行邀请制内测,用户需要使用邀请码进行注册,也可以填写基本信息申请内测。

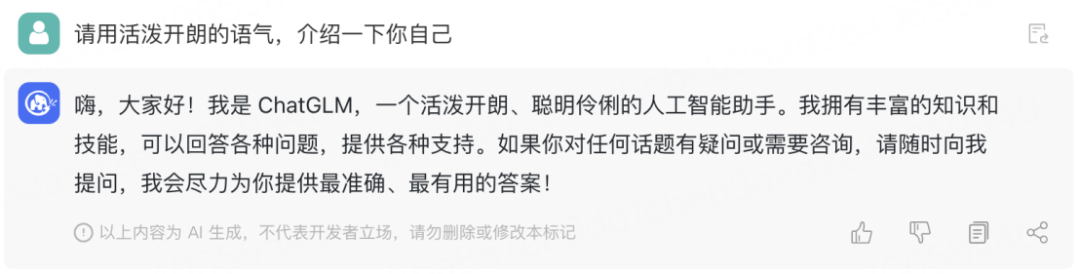

由 ChatGLM 生成的对话效果展示:

整体而言,ChatGLM 距离国际顶尖大模型研究和产品还有一定差距,GLM 团队也在博客中坦言了这一点,并表示将持续研发并开源更新版本的 ChatGLM 和相关模型。欢迎大家下载 ChatGLM-6B,基于它进行研究和(非商用)应用开发。GLM 团队希望能和开源社区研究者和开发者一起,推动大模型研究和应用在中国的发展。

☞香港科技大学:期中报告使用 ChatGPT 可加分;爆谷歌、微软已在韩国开始裁员;美国最大加密货币银行宣布关闭|极客头条 ☞烧数亿美元、耗上万颗英伟达 GPU,微软揭秘构建 ChatGPT 背后超级计算机往事 ! ☞各家的“ChatGPT”什么时候能取代程序员?CSDN AI编程榜发布

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

- 1 中国经济向世界提供“机遇清单” 7904541

- 2 朱元璋换帅照后明孝陵火了 7809507

- 3 水银体温计将禁产 有网友囤货100支 7712543

- 4 2025这些“经济”持续成长壮大 7617075

- 5 近8000吨车厘子来了 7521316

- 6 老人接孙女从认不出到相拥大哭 7425517

- 7 冯提莫自曝癌症复发并转移 7328808

- 8 西班牙女员工连续提前到岗被开除 7233372

- 9 喜茶600多家店消失 7143198

- 10 寒潮来袭!多地气温将创下半年来新低 7039973

CSDN

CSDN