第一次在全球所有时区共同开启的英伟达 GTC 大会,为我们带来了全新一代安培架构的 Quadro 显卡,面向服务器的 DPU 产品线,同时还有一款价格超低,堪比树莓派的 Jetson 芯片。

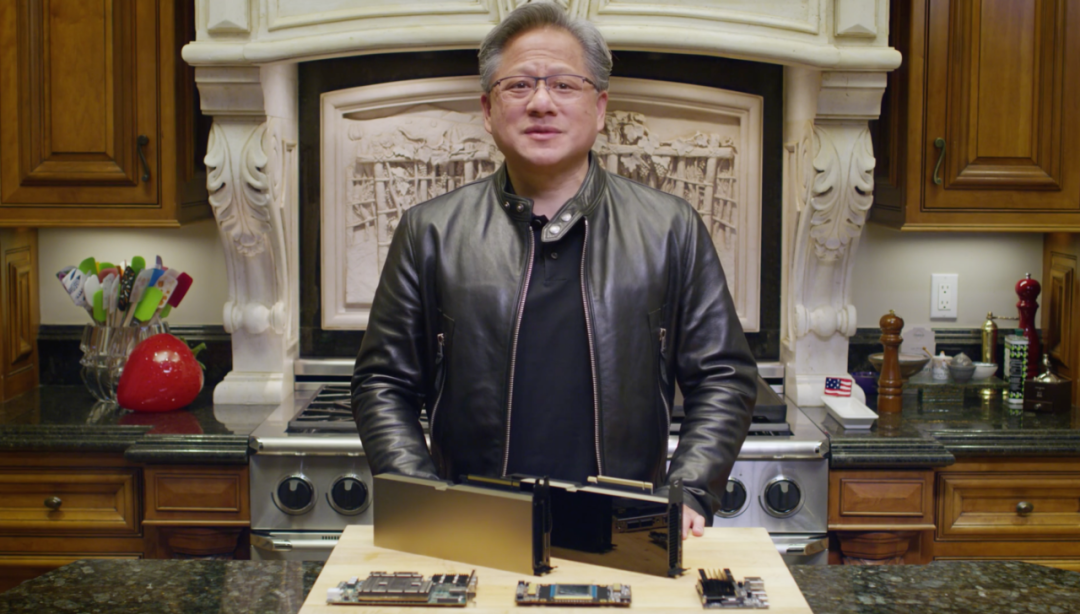

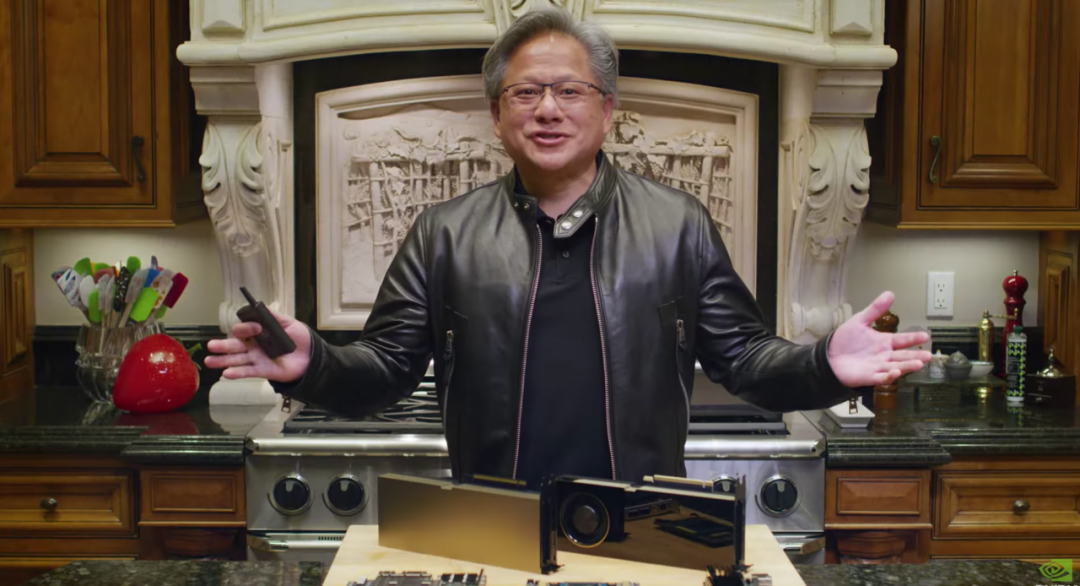

「现在软件已经可以自动生成软件了,AI 就是自动化过程中的自动化力量,」英伟达创始人黄仁勋在昨天的 GTC 秋季大会开场 Keynote 中说道。「AI 编写的软件和人类大有不同,它们更加并行化,计算集中程度更是后者的千百倍。既然构建软件的方式不同,那么构建它们的计算基础设施、工具、软件以及开发方式也要不同。」人工智能需要人们重新思考计算的方法,从芯片、系统、算法、工具再到生态系统。面对如此挑战,英伟达给出了自己的最新答案。在昨天的 GTC Fall 活动中,黄仁勋发布了安培架构的新一代专业级显卡 Quadro RTX Ampere,并宣布将于今年 12 月交付。「我知道你们都在急切地想要抢到自己的安培 GPU——这是绝对可以理解的,我可以保证你的等待是值得的。安培是英伟达历史上最大的一次跃升,我们每次放出新货都是立刻售罄,」黄仁勋表示。「我们正在加班加点,你的新显卡正在路上。」不过这次要发布的是专业级的 GPU。NVIDIA 的新一代 Quadro RTX 显卡 A6000,与此前推出的 RTX 30 系列一样使用三星的 8nm 工艺打造,采用 GA102 GPU,最高配备 10752CUDA 核心,比 RTX 3090 还多 256 个。A6000 的内存也达到了 48GB,不过使用的是 DDR6 而非 GDDR6X,因为目前后者无法实现足够高的容量。

在性能方面,英伟达宣称 A6000 在一些任务上的能力是上一代产品 Quadro RTX 8000 的两倍,这主要是通过制程提升、吞吐量增加、新浮点算法以及内存容量提升实现的。目前英伟达还未提供 A6000 的更多具体数据,以及最重要的价格。已知的是,A6000 的功耗比 3090 要低 50W,仅为 300W。另有一款功率相同的被动散热计算卡 Quadro A40 也将于 2021 年第一季度上市。A40 几乎具有与主动冷却的 A6000 相同的所有功能,只是采用了纯被动散热的形式,适用于高密度服务器。

有了 RTX 显卡的算力,英伟达还推出了 3D 仿真模拟和协作平台 Omniverse,通过这一工具,图像技术开发者们能够实时模拟出细节逼真的现实世界。它可以让负责 3D 建筑设计的建筑师、修改 3D 场景的动画师以及协作开发自动驾驶汽车的工程师,像线上共同编辑文档一样轻松设计 3D 虚拟场景。

目前,Omniverse 已获得了许多主要专业软件的支持,如 Adobe、Autodesk、Bentley Systems、Robert McNeel & Associates 和 SideFX 等。在本次 GTC 上,英伟达还宣布 Omniverse 进入公测阶段,将于今年秋季开放下载。「任何动起来的东西,在未来或多或少都会是自动化的。AI 技术的突破已经让各种各样的机器人形态成为可能,」黄仁勋说道。「但我们还需要 Jetson AI 的算力把这些机器人实用化。」和以往一样,Jetson 拥有一个 Arm 架构的 SoC,也支持 CUDA,并拥有自己的 Tensor Core。而更重要的是,昨天新发布的 Jetson Nano 2GB 价格已经低至 59 美元一块——这是一个和树莓派(Raspberry Pi 4)接近的低价。现在,英伟达希望所有人都可以使用 GPU 制造自己的机器人。

构建机器人相关的软件和 AI 的开发流程有些类似,人们会使用 DGX 这样的设备编写和训练,并在 Jetson 这样的端侧运行。在实践中,英伟达研究人员已经训练了很多现成模型,使用迁移学习工具,任何人都可以把它们应用在自己的任务上。在机器人领域,现在还可以通过实时的 AI 模拟环境大幅度提高训练的效率。

图片来自 anandtech。

除了价格更低之外,Jetson Nano 2GB 的计算配置和常规 Jetson Nano 相同,有 4 个 Cortex-A57 CPU 内核的 CPU,以及 128 个 CUDA 核的 Maxwell 架构 GPU。不过 2GB 版本相比标准版少了 DisplayPort 输出,USB 接口也不是 3.0 的。

还记得刚发布的奔驰 S 级吗?这台车是梅赛德斯有史以来最智能化的车型,其中搭载了三块带英伟达 GPU 的计算芯片。在 GTC Keynote 上,英伟达还宣布了和奔驰的新合作计划:到 2024 年,所有奔驰车系都将搭载英伟达的 DRIVE AV 芯片。

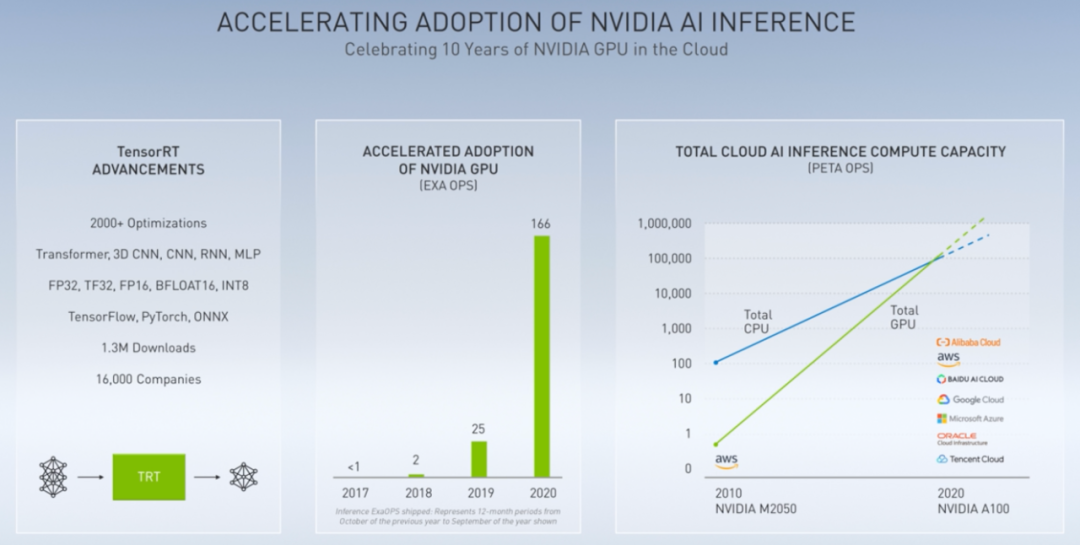

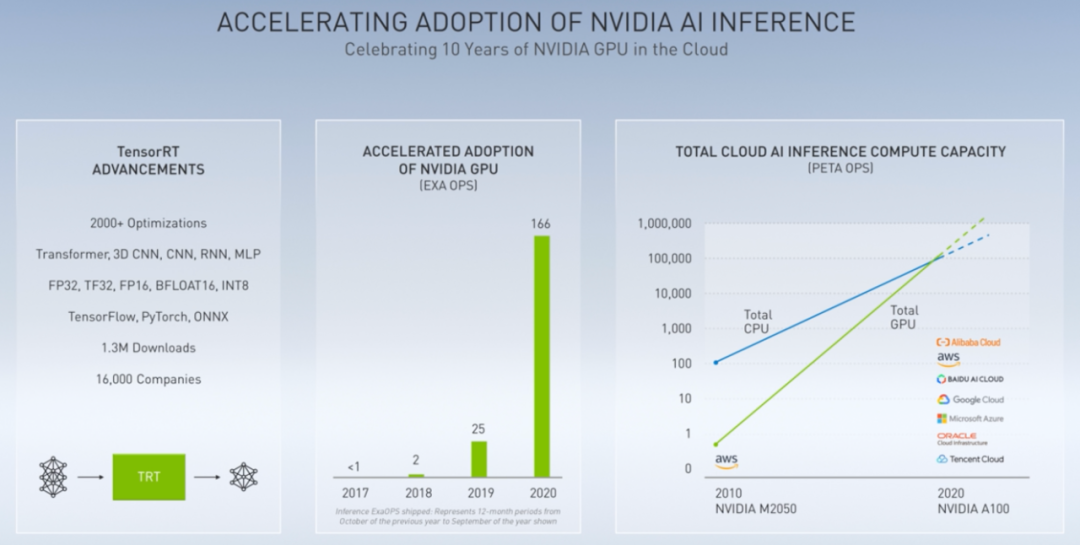

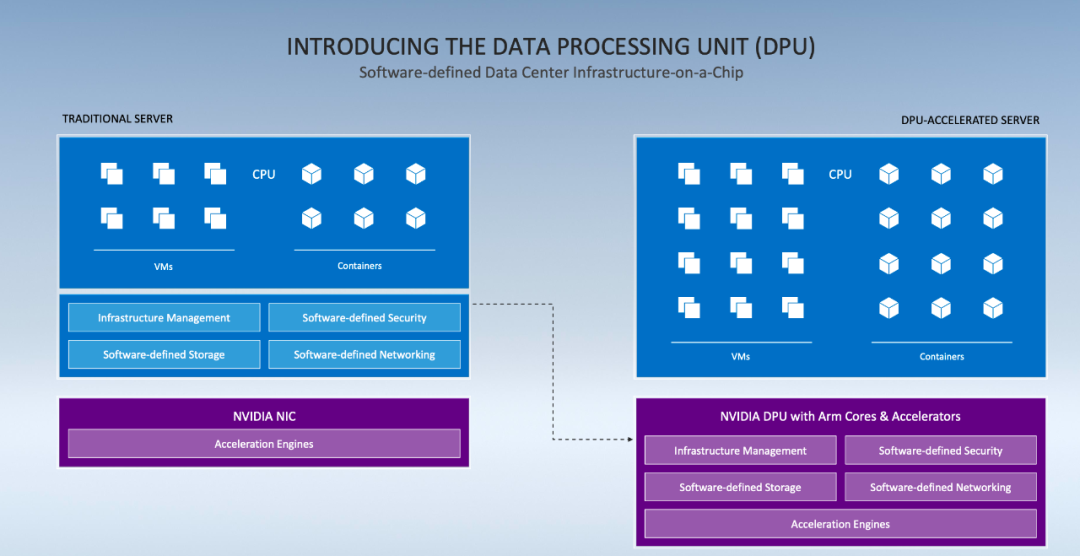

推出 DPU,基于 Arm 架构的可编程数据中心芯片我们都知道英伟达正在收购 Arm,不过相比商业行为,英伟达的技术进展更快一些。这家公司在收购 Mellanox 之后,共同研发了新一代计算单元 DPU。英伟达推测,全球服务器的算力吞吐总量每两年增长十倍,而在 2020 年中,仅在 AI 推断任务中,在所有云服务器中使用 GPU 的算力数量已经超过了 CPU。「按照这个趋势,在几年之后英伟达的 GPU 将会承载超过 90% 的全球 AI 推理算力。任何 AI 的应用和服务现在都可以基于英伟达芯片,」黄仁勋说道。

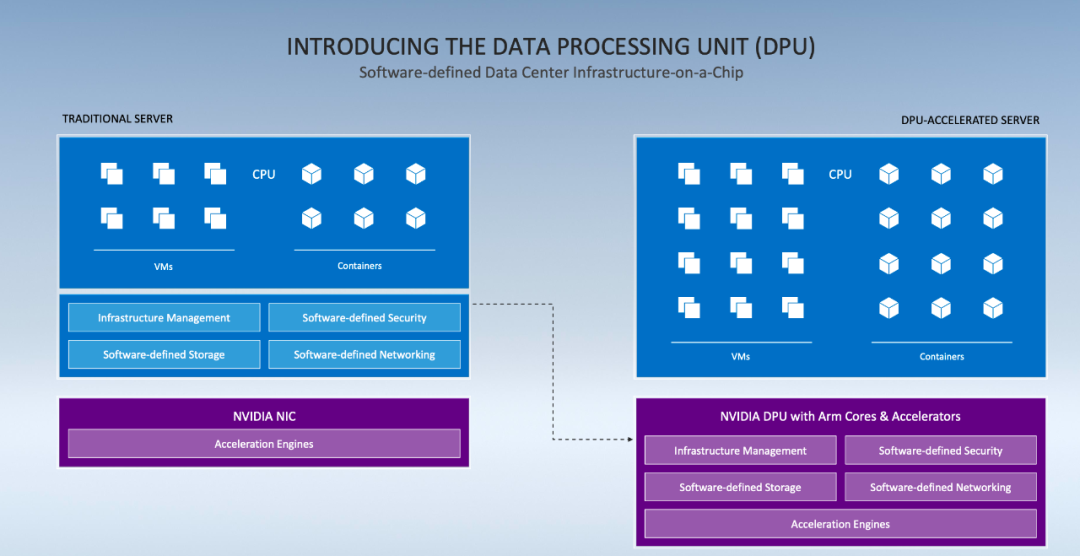

AI 和数据分析应用必须是分布式的,由多个 GPU 和节点负责运算,云服务实际上也是巨量的「微服务」,这种新型的工作负载对虚拟化、网络、存储和安全提出了新的要求。在数据中心的计算设备上,人们提出了 DPU(Data Processing Unit)的新概念。这是一种更多通过软件定义的基础设施芯片。

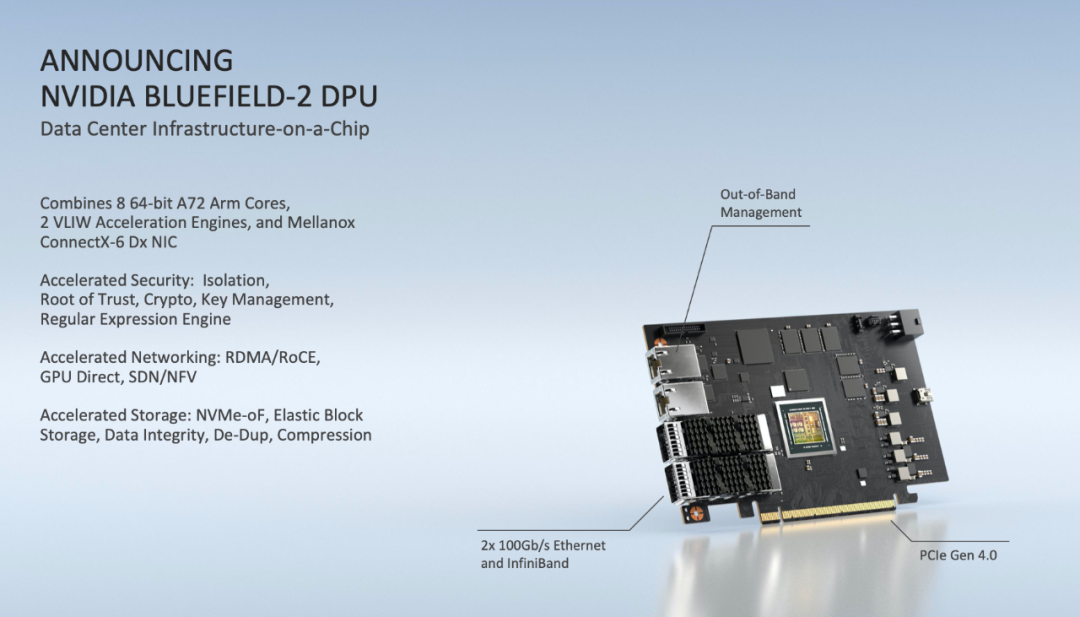

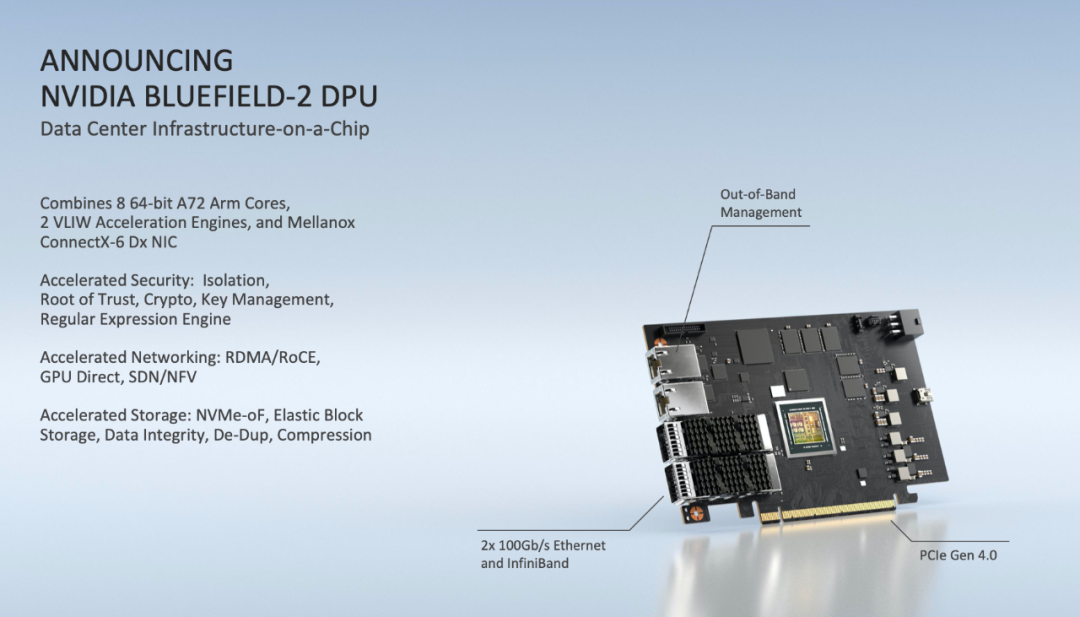

新发布的 DPU 名为 Bluefield-2,这种计算卡是以可编程 Arm 架构 CPU 为核心运作的。

Bluefield-2 DPU 拥有 70 亿晶体管,将可编程的数据中心压缩成芯片大小。与之相对的,英伟达也发布了 DOCA——可编程数据中心基础设施处理器的软件架构,允许开发者在 DPU 上构建自己的应用。英伟达表示,DOCA 可以无缝兼容所有主流系统。

Bluefield-2 只是一个开始,在英伟达的计划中,Bluefield-4 将会引入 CUDA 和 NVIDIA AI,大大加速网络中计算机视觉应用处理的速度。如果用户现在就对 AI 算力有很高需求,英伟达也发布了 Bluefield-2X,其中的安培架构 GPU 核心可以用于处理所需任务。「Bluefield-2X 可以让你就像已经拥有了 Bluefield-4 一样,」黄仁勋说道。「在几年之后,我们将会带来近 1000 倍的吞吐量,并提供 200-400Gbps 的数据速度。」

在推动收购 Arm 的同时,英伟达也宣布了支持 Arm 架构的新三大战略:提供更多对 Arm 架构的 GPU、网络、存储和安全的支持,实现更完整的加速平台;与合作伙伴开发覆盖从端侧到 HPC 所有平台的设备;接入 NVIDIA AI 和 NVIDIA RTX 技术到 Arm 架构——此前这些支持仅限于 X86。英伟达发布的这些产品,全部是为了开发者能够在构建 AI 技术时获得更多力量。在昨天的 GTC 上,英伟达一口气升级和更新了 80 款 SDK,目前旗下工具的总量达到了 110 款。目前全球使用英伟达 CUDA 等工具的开发者数量已达到 200 万人。「在 AI 时代的新形式计算中,我们会为探索前沿方向和技术民主化亲尽全力。」黄仁勋说道。如何根据任务需求搭配恰当类型的数据库?

在AWS推出的白皮书《进入专用数据库时代》中,介绍了8种数据库类型:关系、键值、文档、内存中、关系图、时间序列、分类账、领域宽列,并逐一分析了每种类型的优势、挑战与主要使用案例。

点击阅读原文或识别二维码,申请免费获取白皮书。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com

关注公众号:拾黑(shiheibook)了解更多

[广告]赞助链接:

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

机器之心

机器之心

关注网络尖刀微信公众号

关注网络尖刀微信公众号